Psychologische und Technische Risiken

In „meinem“ Co‑Working‑Space erzählte mir kürzlich ein Kollege, sein Arbeitgeber stelle keinen firmenseitigen KI‑Chatbot bereit also löse er seine Fragen mit dem privaten Account.

Inmitten aller Debatten um KI‑Hypes überrascht es ein wenig, dass grundlegende, sichere Funktionen noch immer nicht flächendeckend verfügbar sind mit potenziell gravierenden Folgen. Technisch ist das Problem leicht zu lösen doch in vielen Unternehmen fehlt eine zugelassene, leicht nutzbare KI‑Umgebung. IBM berichtet auf Basis einer Erhebung, dass 38% der Mitarbeiter vertrauliche Informationen in KI Tools ohne Erlaubnis nutzten.1 Über 10% der Security-Vorfälle sind auf Schatten-IT (also nicht offiziell genehmigte Systeme) zurückzuführen 2.

Die Zahlen legen nahe, dass die meisten Unternehmen betroffen sind. Wenn ein Unternehmen keine einfache Option bietet, schafft der Nutzer sich selbst eine. Doch warum spricht kaum jemand darüber? Weil zwei fundamentale Prinzipien erfolgreicher Organisationen nicht berücksichtigt werden: technische Sicherheit und psychologische Sicherheit.

Kein Luxus: Technische Sicherheit

Vertrauliche Unterlagen lagert man nicht in die DB‑Lounge am Bahnhof. Das ist offensichtlich und doch fehlt oft der Ort, an dem Mitarbeitende sicher digital arbeiten können. Fehlt dieser Ort, entstehen Schattenlösungen wie private Chat‑Apps. Dies ist kein theoretisches Risiko, sondern ein ganz konkretes: Mit jedem Prompt wandern Daten aus dem geschützten Raum in die Wildnis des Internets.

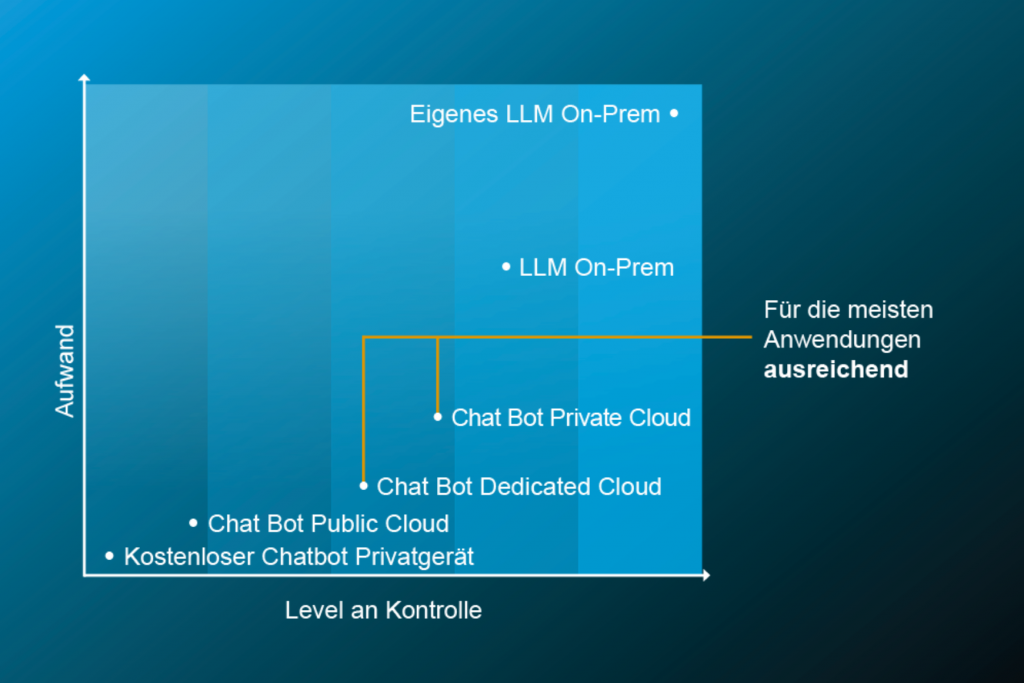

Unternehmen, die keine zugänglichen KI‑Werkzeuge anbieten, dürfen sich nicht wundern, wenn Mitarbeitende eigene Wege gehen. Besonders wenn gleichzeitig Produktivitätsgewinne erwartet werden. Die Lösung muss pragmatisch sein: ein abgesicherter, leicht erreichbarer Chatbot lässt sich leicht einrichten. Es gibt viele Stufen, um die Sicherheit zu steigern aber wenn sie aktuell auf dem Level sind, wo ihre Mitarbeiter ihre eigenen Lösungen nutzen ist dies ein absolut notwendiger, kleiner Schritt die Sicherheit massiv zu erhöhen.

Abbildung: Die Grafik zeigt symbolisch verschiedene Optionen, KI‑Fähigkeiten bereitzustellen. Bereits ein vergleichsweise geringer Aufwand führt zu einem in der Praxis meist völlig ausreichenden Maß an Datenkontrolle und deutlich höherer Sicherheit.

Bereits mit begrenzten Ressourcen können Sie Kontrolle und damit Sicherheit deutlich erhöhen. Zum Beispiel durch die einfache Bereitstellung einer ChatGPT‑Business‑ oder Enterprise‑Version oder vergleichbarer Angebote von Microsoft, Anthropic, Mistral etc.. Damit allein wird der mögliche Produktivitätsgewinn zwar noch nicht realisiert, aber die dafür notwendige Grundlage geschaffen.

Eine dedizierte Cloud‑Lösung für einen Chatbot ist besonders dann sinnvoll, wenn Unternehmen mehr Kontrolle über ihre Daten wollen, ohne selbst eine komplexe Infrastruktur betreiben zu müssen. In einer solchen Umgebung bleiben Unternehmensdaten klar getrennt, und der Anbieter übernimmt Updates, Sicherheit und Betrieb. Noch mehr Kontrolle bietet ein Modell, das als Service in der eigenen Private‑Cloud‑Umgebung läuft. Diese Variante eignet sich vor allem für Unternehmen, die mit sehr sensiblen Daten arbeiten oder strenge Compliance‑Vorgaben erfüllen müssen.

Eine lokale Bereitstellung von KI‑Modellen „on-premise“ kann in bestimmten Fällen sinnvoll sein wie bei hohen Anforderungen an Datenschutz, Latenz oder Kostenkontrolle. Zukünftige Entwicklungen und neue Standardlösungen werden diese Option weiter attraktiver machen und den Implementierungsaufwand senken. Aktuelle Produkte wie Copilot+ oder der HP AI Companion bieten zwar bereits lokale KI‑Funktionen, erreichen jedoch ohne Cloud‑Anbindung nicht die Leistungsfähigkeit moderner Cloud‑LLMs. Für rein lokale Szenarien ist daher weiterhin deutlich mehr eigener Aufwand erforderlich.

Die Entwicklung eines vollständig eigenen KI‑Modells lohnt sich für die meisten Unternehmen nicht: Sie ist teuer, komplex und nur in Ausnahmefällen strategisch sinnvoll.

Fazit: Geeignete Systeme lassen sich schneller und mit weniger Aufwand einführen, als es in vielen Unternehmen angenommen wird.

Systeme sicher, aber Menschen nicht? Psychologische Sicherheit

Technische Maßnahmen allein genügen nicht. Neue Technologien verlangen ein Umfeld, in dem Mitarbeitende Risiken eingehen dürfen. Das heißt: Fragen stellen, ohne sich dumm zu fühlen; Fehler melden, ohne Repressalien zu fürchten; Neues ausprobieren dürfen, ohne dass der Bonus auf dem Spiel steht. Google hat in der Studie „Aristotle“ gezeigt, dass nicht die Zusammensetzung eines Teams, sondern die Art des Miteinanders über Erfolg entscheidet und dass psychologische Sicherheit den stärksten Einfluss auf die Teams-Performance hat. Weit mehr als Seniorität, Arbeitspensum, oder individuelle Beiträge einzelner.3

Gerade bei KI, wo Unsicherheit und diffuse Ängste noch groß sind, ist diese Kultur entscheidend. Wer Experimente vermeidet oder scheitern sanktioniert, verhindert Lernen. Wer hingegen kleine, kontrollierte Experimente fördert und aus Fehlern Erkenntnisse zieht, wird inkrementell immer besser werden und damit über die Zeit echte Wettbewerbsvorteile erreichen.

Technik und Vertrauen: Was die KI nicht kann aber braucht

Technische und psychologische Sicherheit sind komplementär. Ohne Technik entstehen Risiken durch Datenlecks; ohne eine Kultur, die den Mitarbeitern Sicherheit bietet, bleiben Experimente aus und mit ihnen Erkenntnisse. Unternehmen, die Innovation ernst nehmen, kombinieren beides: Sie bieten eine sichere Toolumgebung und schaffen gleichzeitig eine Führungskultur, die Experimente erlaubt, Fehler analysiert und Erkenntnisse teilt. Wer beides vernachlässigt, riskiert sowohl Sicherheitsvorfälle als auch Innovationsstau.

Was also kann ich dem Unternehmen meines Kollegen empfehlen?

- Sofortmaßnahme: Falls nicht vorhanden, stellen Sie eine leicht zugängliche, sichere KI Chat Lösung bereit (z.b dedicated Cloud Lösung). Dies ist innerhalb von Tagen umsetzbar!

- Kurzfristig: Bewerten Sie ihre Erfahrung aus den Sofortmaßnahmen. Ermitteln sie technische Risiken als auch wie es um die psychologische Sicherheit in Ihren Teams steht.

- Mittel- bis langfristig: Etablieren Sie eine Fehlerkultur die Lernen und Innovation fördert. Führen Sie verschiedene kleine, kontrollierte Pilotprogramme durch. Erweitern sie ihr technisches KI Zielbild und Gouvernance so, das Sicherheit und Businessziele im Einklang sind.

Niemand kann heute verlässlich prognostizieren, wie sich KI langfristig auswirken wird. Diese Ungewissheit erzeugt diffuse Ängste, die lähmen können. Die wirksamste Antwort ist das strukturierte Auseinandersetzen damit in sicherer Umgebung; Technisch und zwischenmenschlich. Beides ist messbar, beides ist steuerbar und beides entscheidet über die Frage, ob KI ein Produktivitätshebel oder ein Risiko für Ihr Unternehmen wird.

Brauchen Sie Einsicht in Ihre IT-Risiken? Oder die psychologische Sicherheit eines Projektteams? Buchen Sie einen kurzen, kostenlosen Termin. In 30 Minuten prüfen wir gemeinsam:

1) Gibt es genehmigte KI‑Tools?

2) Werden Schattenlösungen genutzt?

3) Wie steht es um die Fehlerkultur?

Die erste Hürde haben Sie damit genommen!

Fußnoten / Quellen

- https://www.ibm.com/think/topics/shadow-ai ↩︎

- https://www.infosecurity-magazine.com/news/85-firms-cyber-incidents-11-shadow/ ↩︎

- https://rework.withgoogle.com/intl/en/guides/understand-team-effectiveness ↩︎

Titel: Photo by Microsoft Copilot on Unsplash